Robots index follow что это

Полное руководство по метатегам robots и X-Robots-Tag: все, что вам нужно знать

Перед вами дополненный (конечно же, выполненный с любовью) перевод статьи Robots Meta Tag & X-Robots-Tag: Everything You Need to Know c блога Ahrefs. Дополненный, потому что в оригинальном материале «Яндекс» упоминается лишь вскользь, а в главе про HTTP-заголовки затрагивается только сервер Apache. Мы дополнили текст информацией по метатегам «Яндекса», а в части про X-Robots-Tag привели примеры для сервера Nginx. Так что этот перевод актуален для наиболее популярных для России поисковых систем и веб-серверов. Круто, правда?

Направить поисковые системы таким образом, чтобы они сканировали и индексировали ваш сайт именно так, как вы того хотите, порой может быть непросто. Хоть robots.txt и управляет доступностью вашего контента для ботов поисковых систем, он не указывает краулерам на то, стоит индексировать страницы или нет.

Для этой цели существуют метатеги robots и HTTP-заголовок X-Robots-Tag.

Давайте проясним одну вещь с самого начала: вы не можете управлять индексацией через robots.txt. Распространенное заблуждение — считать иначе.

Правило noindex в robots.txt официально никогда не поддерживалось Google. 2 июля 2019 года Google опубликовал новость, в которой описал нерелевантные и неподдерживаемые директивы файла robots.txt. С 1 сентября 2019 года такие правила, как noindex в robots.txt, официально не поддерживаются.

Из этого руководства вы узнаете:

Что такое метатег robots

Это фрагмент HTML-кода, который указывает поисковым системам, как сканировать и индексировать определенную страницу. Robots помещают в контейнер кода веб-страницы, и выглядит это следующим образом:

Почему метатег robots важен для SEO

Метатег robots обычно используется для того, чтобы предотвратить появление страниц в выдаче поисковых систем. Хотя у него есть и другие возможности применения, но об этом позже.

Есть несколько типов контента, который вы, вероятно, хотели бы закрыть от индексации поисковыми системами. В первую очередь это:

В общем, чем больше ваш веб-сайт, тем больше вам придется поработать над управлением краулинговой доступностью и индексацией. Еще вы наверняка хотели бы, чтобы Google и другие поисковые системы сканировали и индексировали ваш сайт с максимально возможной эффективностью. Да? Для этого нужно правильно комбинировать директивы со страницы, robots.txt и sitemap.

Какие значения и атрибуты есть у метатега robots

Метатег robots содержит два атрибута: name и content.

Следует указывать значения для каждого из этих атрибутов. Их нельзя оставлять пустыми. Давайте разберемся, что к чему.

Атрибут name и значения user-agent

Атрибут name уточняет, для какого именно бота-краулера предназначены следующие после него инструкции. Это значение также известно как user-agent (UA), или «агент пользователя». Ваш UA отражает то, какой браузер вы используете для просмотра страницы, но вот у Google UA будет, например, Googlebot или Googlebot-image.

Значения user-agent, robots, относится только к ботам поисковых систем. Цитата из официального руководства Google:

Вы можете добавить столько метатегов для различных роботов, сколько вам нужно. Например, если вы не хотите, чтобы картинки с вашего сайта появлялись в поисковой выдаче Google и Bing, то добавьте в шапку следующие метатеги:

Примечание: оба атрибута — name и content — нечувствительны к регистру. То есть абсолютно не важно, напишите ли вы их с большой буквы или вообще ЗаБоРчИкОм.

Атрибут content и директивы сканирования и индексирования

Ниже приведены поддерживаемые значения атрибута content.

Значение по умолчанию для index, follow. Вы спросите: зачем оно вообще нужно, если без этой директивы будет равным образом то же самое? И будете чертовски правы. Нет абсолютно никакого смысла ее использовать. Вообще.

noindex

Указывает ПС на то, что данную страницу индексировать не нужно. Соответственно, в SERP она не попадет.

nofollow

Краулеры не будут переходить по ссылкам на странице, но следует заметить, что URL страниц все равно могут быть просканированы и проиндексированы, в особенности если на них ведут внешние ссылки.

Комбинация noindex и nofollow как кофе «два в одном». Google и Yandex поддерживают данную директиву, а вот, например, Bing — нет.

noarchive

Предотвращает показ кешированной версии страницы в поисковой выдаче.

notranslate

Говорит Google о том, что ему не следует предлагать перевод страницы в SERP. «Яндексом» не поддерживается.

noimageindex

Запрещает Google индексировать картинки на странице. «Яндексом» не поддерживается.

unavailadle_after

nosnippet

Отключает все текстовые и видеосниппеты в SERP. Кроме того, работает и как директива noarchive. «Яндексом» не поддерживается.

С октября 2019 года Google предлагает более гибкие варианты управления отображением сниппетов в поисковой выдаче. Сделано это в рамках модернизации авторского права в Евросоюзе. Франция стала первой страной, которая приняла новые законы вместе со своим обновленным законом об авторском праве.

Новое законодательство хоть и введено только в Евросоюзе, но затрагивает владельцев сайтов повсеместно. Почему? Потому что Google больше не показывает сниппеты вашего сайта во Франции (пока только там), если вы не внедрили на страницы новые robots-метатеги.

Мы описали каждый из нововведенных тегов ниже. Но вкратце: если вы ищете быстрое решение для исправления сложившейся ситуации, то просто добавьте следующий фрагмент HTML-кода на каждую страницу сайта. Код укажет Google на то, что вы не хотите никаких ограничений по отображению сниппетов. Поговорим об этом более подробно далее, а пока вот:

Заметьте, что если вы используете Yoast SEO, этот фрагмент кода уже добавлен на все ваши страницы, при условии, что они не отмечены директивами noindex или nosnippet.

Нижеуказанные директивы не поддерживаются ПС «Яндекс».

max-snippet

Уточняет, какое максимальное количество символов Google следует показывать в своих текстовых сниппетах. Значение «0» отключит отображение текстовых сниппетов, а значение «-1» укажет на то, что верхней границы нет.

Вот пример тега, указывающего предел в 160 символов (стандартная длина meta description):

max-image-preview

Сообщает Google, какого размера картинку он может использовать при отображении сниппета и может ли вообще. Есть три опции:

max-video-preview

Устанавливает максимальную продолжительность видеосниппета в секундах. Аналогично текстовому сниппету значение «0» выключит опцию показа видео, значение «-1» укажет, что верхней границы по продолжительности видео не существует.

Например, вот этот тег скажет Google, что максимально возможная продолжительность видео в сниппете — 15 секунд:

noyaca

Запрещает «Яндексу» формировать автоматическое описание с использованием данных, взятых из «Яндекс.Каталога». Для Google не поддерживается.

Примечание относительно использования HTML-атрибута data-nosnippet

Вместе с новыми директивами по метатегу robots, представленными в октябре 2019 года, Google также ввел новый HTML-атрибут data-nosnippet. Атрибут можно использовать для того, чтобы «заворачивать» в него фрагменты текста, который вы не хотели бы видеть в качестве сниппета.

Новый атрибут может быть применен для элементов

Фрагмент этого текста может быть показан в сниппете за исключением этой части.

Использование вышеуказанных директив

В большинстве случаев при поисковой оптимизации редко возникает необходимость выходить за рамки использования директив noindex и nofollow, но нелишним будет знать, что есть и другие опции.

Вот таблица для сравнения поддержки различными ПС упомянутых ранее директив.

| Директива | «Яндекс» | Bing | |

|---|---|---|---|

| all | ✅ | ✅ | ❌ |

| noindex | ✅ | ✅ | ✅ |

| nofollow | ✅ | ✅ | ✅ |

| none | ✅ | ✅ | ❌ |

| noarchive | ✅ | ✅ | ✅ |

| nosnippet | ✅ | ❌ | ✅ |

| max-snippet | ✅ | ❌ | ❌ |

| max-snippet-preview | ✅ | ❌ | ❌ |

| max-video-preview | ✅ | ❌ | ❌ |

| notranslate | ✅ | ❌ | ❌ |

| noimageindex | ✅ | ❌ | ❌ |

| unavailable_after: | ✅ | ❌ | ❌ |

| noyaca | ❌ | ✅ | ❌ |

| index|follow|archive | ✅ | ✅ | ✅ |

Вы можете сочетать различные директивы.

И вот здесь очень внимательно

Если директивы конфликтуют друг с другом (например, noindex и index), то Google отдаст приоритет запрещающей, а «Яндекс» — разрешающей директиве. То есть боты Google истолкуют такой конфликт директив в пользу noindex, а боты «Яндекса» — в пользу index.

Примечание: директивы, касающиеся сниппетов, могут быть переопределены в пользу структурированных данных, позволяющих Google использовать любую информацию в аннотации микроразметки. Если вы хотите, чтобы Google не показывал сниппеты, то измените аннотацию соответствующим образом и убедитесь, что у вас нет никаких лицензионных соглашений с ПС, таких как Google News Publisher Agreement, по которому поисковая система может вытягивать контент с ваших страниц.

Как настроить метатеги robots

Теперь, когда мы разобрались, как выглядят и что делают все директивы этого метатега, настало время приступить к их внедрению на ваш сайт.

Как уже упоминалось выше, метатегам robots самое место в head-секции кода страницы. Все, в принципе, понятно, если вы редактируете код вашего сайта через разные HTML-редакторы или даже блокнот. Но что делать, если вы используете CMS (Content Management System, в пер. — «система управления контентом») со всякими SEO-плагинами? Давайте остановимся на самом популярном из них.

Внедрение метатегов в WordPress с использованием плагина Yoast SEO

Тут все просто: переходите в раздел Advanced и настраивайте метатеги robots в соответствии с вашими потребностями. Вот такие настройки, к примеру, внедрят на вашу страницу директивы noindex, nofollow:

Строка meta robots advanced дает вам возможность внедрять отличные от noindex и nofollow директивы, такие как max-snippet, noimageindex и так далее.

Еще один вариант — применить нужные директивы сразу по всему сайту: открывайте Yoast, переходите в раздел Search Appearance. Там вы можете указать нужные вам метатеги robots на все страницы или на выборочные, на архивы и структуры сайта.

Примечание: Yoast — вовсе не единственный способ управления вашим метатегами в CMS WordPress. Есть альтернативные SEO-плагины со сходным функционалом.

Что такое X-Robots-Tag

Метатеги robots замечательно подходят для того, чтобы закрывать ваши HTML-страницы от индексирования, но что делать, если, например, вы хотите закрыть от индексирования файлы типа изображений или PDF-документов? Здесь в игру вступает X-Robots-Tag.

X-Robots-Tag — HTTP-заголовок, но, в отличие от метатега robots, он находится не на странице, а непосредственно в файле конфигурации сервера. Это позволяет ему сообщать ботам поисковых систем инструкции по индексации страницы даже без загрузки содержимого самой страницы. Потенциальная польза состоит в экономии краулингового бюджета, так как боты ПС будут тратить меньше времени на интерпретацию ответа страницы, если она, например, будет закрыта от индексации на уровне ответа веб-сервера.

Вот как выглядит X-Robots-Tag:

Чтобы проверить HTTP-заголовок страницы, нужно приложить чуть больше усилий, чем требуется на проверку метатега robots. Например, можно воспользоваться «дедовским» методом и проверить через Developer Tools или же установить расширение на браузер по типу Live HTTP Headers.

Последнее расширение мониторит весь HTTP-трафик, который ваш браузер отправляет (запрашивает) и получает (принимает ответы веб-серверов). Live HTTP Headers работает, так сказать, в прямом эфире, так что его нужно включать до захода на интересующий сайт, а уже потом смотреть составленные логи. Выглядит все это следующим образом:

Как правильно внедрить X-Robots-Tag

Конфигурация установки в целом зависит от типа используемого вами сервера и того, какие страницы вы хотите закрыть от индексирования.

Строчка искомого кода для веб-сервера Apache будет выглядеть так:

Header set X-Robots-Tag «noindex»

add_header X-Robots-Tag «noindex, noarchive, nosnippet»;

X-Robots-Tag оперирует теми же директивами и значениями атрибутов, что и метатег robots. Это из хороших новостей. Из тех, что не очень: даже малюсенькая ошибочка в синтаксисе может положить ваш сайт, причем целиком. Так что два совета:

Подсказка: если вы используете CDN (Content Delivery Network), поддерживающий бессерверную архитектуру приложений для Edge SEO, вы можете изменить как метатеги роботов, так и X-Robots-теги на пограничном сервере, не внося изменений в кодовую базу.

Когда использовать метатеги robots, а когда — X-Robots-tag

Да, внедрение метатегов robots хоть и выглядит более простым и понятным, но зачастую их применение ограничено. Рассмотрим три примера.

Файлы, отличные от HTML

Ситуация: нужно впихнуть невпихуемое.

Фишка в том, что у вас не получится внедрить фрагмент HTML-кода в изображения или, например, в PDF-документы. В таком случае X-Robots-Tag — безальтернативное решение.

Вот такой фрагмент кода задаст HTTP-заголовок со значением noindex для всех PDF-документов на сайте для сервера Apache:

Header set X-Robots-Tag «noindex»

А такой — для nginx:

Масштабирование директив

Если есть необходимость закрыть от индексации целый домен (поддомен), директорию (поддиректорию), страницы с определенными параметрами или что-то другое, что требует массового редактирования, ответ будет один: используйте X-Robots-Tag. Можно, конечно, и через метатеги, но так будет проще. Правда.

Изменения заголовка HTTP можно сопоставить с URL-адресами и именами файлов с помощью различных регулярных выражений. Массовое редактирование в HTML с использованием функции поиска и замены, как правило, требует больше времени и вычислительных мощностей.

Трафик с поисковых систем, отличных от Google

Google поддерживает оба способа — и robots, и X-Robots-Tag. «Яндекс» хоть и с отставанием, но в конце концов научился понимать X-Robots-Tag и успешно его поддерживает. Но, например, чешский поисковик Seznam поддерживает только метатеги robots, так что пытаться закрыть сканирование и индексирование через HTTP-заголовок не стоит. Поисковик просто не поймет вас. Придется работать с HTML-версткой.

Как избежать ошибок доступности краулинга и деиндексирования страниц

Вам, естественно, нужно показать пользователям все ваши страницы с полезным контентом, избежать дублированного контента, всевозможных проблем и не допустить попадания определенных страниц в индекс. А если у вас немаленький сайт с тысячами страниц, то приходится переживать еще и за краулинговый бюджет. Это вообще отдельный разговор.

Давайте пробежимся по распространенным ошибкам, которые допускают люди в отношении директив для роботов.

Ошибка 1. Внедрение noindex-директив для страниц, закрытых через robots.txt

Официальные инструкции основных поисковых систем гласят:

Никогда не закрывайте через disallow в robots.txt те страницы, которые вы пытаетесь удалить из индекса. Краулеры поисковых систем просто не будут переобходить такие страницы и, следовательно, не увидят изменения в noindex-директивах.

Если вас не покидает чувство, что вы уже совершили подобную ошибку в прошлом, то не помешает выяснить истину через Ahrefs Site Audit. Смотрите на страницы, отмеченные ошибкой noindex page receives organic traffic («закрытые от индексации страницы, на которые идет органический трафик»).

Если на ваши страницы с директивой noindex идет органический трафик, то очевидно, что они все еще в индексе, и вполне вероятно, что робот их не просканировал из-за запрета в robots.txt. Проверьте и исправьте, если это так.

Ошибка 2. Плохие навыки работы с sitemap.xml

Если вы пытаетесь удалить контент из индекса, используя метатеги robots или X-Robots-Tag, то не стоит удалять их из вашей карты сайта до момента их деиндексации. В противном случае переобход этих страниц может занять у Google больше времени.

— В принципе все, что вы внесете в sitemap.xml, будет рассмотрено быстрее.

Для того чтобы потенциально ускорить деиндексацию ваших страниц, установите дату последнего изменения вашей карты сайта на дату добавления тега noindex. Это спровоцирует переобход и переиндексацию.

Еще один трюк, который вы можете проделать, — загрузить sitemap.xml с датой последней модификации, совпадающей с датой, когда вы отметили страницу 404, чтобы вызвать переобход.

Джон Мюллер говорит здесь про страницы с ошибкой 404, но можно полагать, что это высказывание справедливо и для директив noindex.

Важное замечание

Не оставляйте страницы, отмеченные директивой noindex, в карте сайта на долгое время. Как только они выпадут из индекса, удаляйте их.

Если вы переживаете, что старый, успешно деиндексированный контент по каким-то причинам все еще может быть в индексе, проверьте наличие ошибок noindex page sitemap в Ahrefs Site Audit.

Ошибка 3. Оставлять директивы noindex на страницах, которые уже не находятся на стадии разработки

Закрывать от сканирования и индексации все, что находится на стадии разработки, — это нормальная, хорошая практика. Тем не менее, иногда продукт выходит на следующую стадию с директивами noindex или закрытым через robots.txt доступом к нему. Органического трафика в таком случае вы не дождетесь.

Более того, иногда падение органического трафика может протекать незамеченным на фоне миграции сайта через 301-редиректы. Если новые адреса страниц содержат директивы noindex, или в robots.txt прописано правило disallow, то вы будете получать органический трафик через старые URL, пока они будут в индексе. Их деиндексация поисковой системой может затянуться на несколько недель.

Чтобы предотвратить подобные ошибки в будущем, стоит добавить в чек-лист разработчиков пункт о необходимости удалять правила disallow в robots.txt и директивы noindex перед отправкой в продакшен.

Ошибка 4. Добавление «секретных» URL в robots.txt вместо запрета их индексации

Разработчики часто стараются спрятать страницы о грядущих промоакциях, скидках или запуске нового продукта через правило disallow в файле robots.txt. Работает это так себе, потому что кто угодно может открыть такой файл, и, как следствие, информация зачастую сливается в интернет.

Не запрещайте их в robots.txt, а закрывайте индексацию через метатеги или HTTP-заголовки.

Заключение

Правильное понимание и правильное управление сканированием и индексацией вашего сайта крайне важны для поисковой оптимизации. Техническое SEO может быть довольно запутанным и на первый взгляд сложным, но метатегов robots уж точно бояться не стоит. Надеемся, что теперь вы готовы применять их на практике!

Полное руководство по метатегам robots и X-Robots-Tag

Метатег robots и тег X-Robots нужны для управления индексацией сайта роботами поисковиков. Основное их отличие — в способе реализации: meta robots указывают в html-коде страницы, а тег x-robots — в HTTP-заголовке URL.

Процесс индексации сайта состоит из нескольких этапов: загрузки контента, его анализа и добавления в базу роботами поисковой системы. Информация, попавшая в индекс, начинает отображаться в выдаче.

В статье про файл robots.txt мы рассказывали, как разрешить и запретить роботам сканировать ресурс. Теперь мы узнаем, как управлять индексацией страниц и другого контента, какую пользу это приносит оптимизации, какое содержимое сайта лучше закрывать от поисковиков и как это правильно сделать.

Польза метатега robots и X-Robots-Tag для SEO

Рассмотрим, когда стоит использовать данные теги и как это помогает оптимизировать сайт.

1. Управление индексацией страниц

Не все страницы сайта полезны для привлечения органического трафика. Индексация некоторых из них, например, дублей, может и вовсе навредить видимости ресурса. Поэтому с помощью команды noindex обычно скрывают:

2. Управление индексацией файлов определенного формата

От робота можно скрывать не только html-страницы, но и документ с другим расширением, например, страницу изображения или pdf-файл.

3. Сохранение веса страницы

Запрещая роботам переходить по ссылкам с помощью команды nofollow, можно сохранить вес страницы — он не будет передаваться сторонним ресурсам или другим страницам сайта, которые не приоритетны для индексации.

4. Рациональный расход краулингового бюджета

Чем больше ресурс, тем важнее направлять робота только на самые важные страницы. Если поисковики будут сканировать все подряд, краулинговый бюджет исчерпается до того, как робот начнет сканировать ценный для пользователей и SEO-контент. Соответственно, эти страницы не попадут в индекс или окажутся там с опозданием.

Директивы метатега robots и X-Robots-Tag

Два метода управления индексацией отличаются синтаксисом и способом внедрения. Метатег robots размещают в html-коде страницы и заполняют его атрибуты — параметры с именем робота (name) и командами для него (content). Тег x-robots добавляют в файл конфигурации и атрибуты в этом случае не используют.

Запрет индексации контента роботом Google с помощью метатега robots выглядит так:

Запрет индексации контента роботом Google с помощью тега x-robots имеет такой вид:

При этом у метатегов robots и X-Robots-Tag общие директивы — команды для обращения к роботам поисковиков. Рассмотрим список актуальных директив для разных поисковых систем и их функции.

Функции директив и их поддержка разными поисковиками

| НАЗВАНИЕ | ФУНКЦИЯ ДИРЕКТИВЫ | YANDEX | BING | YAHOO! | |

| index/noindex | Разрешение/запрет индексации текста. Чаще всего используют noindex, чтобы скрыть страницу из результатов выдачи. | + | + | + | + |

| follow/nofollow | Разрешение/запрет перехода роботом по ссылкам на странице. | + | + | + | + |

| archive/noarchive | Разрешение/запрет показа в поиске кэшированной версии страницы. | + | + | + | + |

| all/none | Сочетает в себе две директивы, отвечающие за индексацию текста и ссылок. all — эквивалент index, follow (используется по умолчанию). none — эквивалент noindex, nofollow. | + | + | – | + |

| nosnippet | Запрет отображения сниппета (фрагмента текста) или видео в результатах поиска. | + | – | + | – |

| max-snippet | Ограничивает размер сниппета. Формат директивы: max-snippet:[number], где number — количество символов. | + | – | – | + |

| max-image-preview | Задает максимальный размер изображений для показа страницы в поиске. Формат директивы: max-image-preview:[setting], где setting может иметь значение none, standard или large. | + | – | – | + |

| max-video-preview | Ограничение длительности видео, которые отображаются в поиске. Значение указывают в секундах. Также можно задавать статическое изображение (0) или снимать ограничения (-1). Формат директивы: max-video-preview:[значение] | + | – | – | + |

| notranslate | Запрет перевода страницы в выдаче. | + | – | – | – |

| noimageindex | Запрет индексации изображений страницы. | + | – | – | – |

| unavailable_after | Запрет показа страницы в поиске после определенной даты. Директиву указывают в формате unavailable_after: [дата/время]. | + | – | – | – |

| noyaca | Запрет применения описания из Яндекс.Каталога в сниппете. | – | + | – | – |

В таблице приведены как запрещающие, так и разрешающие команды. Однако индексация «открытого» содержимого сайта происходит по умолчанию и директивы вроде index и follow можно не прописывать.

Сравнение директив Google и Яндекс

Как видно в таблице выше, у Google и Яндекса есть как общие, так и уникальные команды. В Google это nosnippet, max-snippet, max-image-preview, max-video-preview, notranslate, noimageindex, unavailable_after. В Яндексе — noyaca.

Теперь рассмотрим, какие из директив можно использовать в метатеге robots, а какие — в теге X-Robots, чтобы их понимали боты Яндекса и Google.

| Директива | Метатег robots Google | Заголовок X-Robots-Tag Google | Метатег robots Yandex | Заголовок X-Robots-Tag Yandex |

| noindex | + | + | + | + |

| nofollow | + | + | + | + |

| noarchive | + | + | + | + |

| index/ follow/ archive | + | + | + | – |

| none | + | + | + | + |

| all | + | + | + | – |

| nosnippet | + | + | – | – |

| max-snippet | + | + | – | – |

| max-snippet | + | + | – | – |

| max-image-preview | + | + | – | – |

| max-video-preview | + | + | – | – |

| notranslate | + | + | – | – |

| noimageindex | + | + | – | – |

| unavailable_after | + | + | – | – |

| noyaca | – | – | + | – |

Выполнение противоречивых команд

При комбинации директив могут возникать конфликты, когда команды противоречат друг другу, одновременно разрешая и запрещая индексацию определенного фрагмента контента. Результат обработки противоречивых директив зависит от поисковой системы: робот Google выполнит запрещающую команду, а Яндекс — разрешающую. Рассмотрим примеры.

Метатег robots: cинтаксис, виды и примеры

Напомним, что метатег robots — это информация для робота в html-коде. Этот тег размещают в верхнем разделе в html-документе и у него неизменно есть два атрибута — name и content, в которых указывают название робота и директивы для него. Атрибуты метатега всегда должны быть заполнены. В упрощенном виде он выглядит так:

Атрибут name

Этот параметр определяет тип метатега в зависимости от данных страницы, которые он передает поисковым системам. Например, meta name=»description» — краткое описание страницы в сниппете; meta name=»viewport» нужен для оптимизации сайта для мобильных устройств; meta http-equiv=»Content-Type» задает тип документа и его кодировки.

В случае с метатегом meta name=»robots» атрибут name содержит имя робота, для которого действуют правила, перечисленные в атрибуте content. Его функция аналогична директиве User-agent в robots.txt, содержащей идентификатор бота той или иной поисковой системы.

Значение robots используют, если нужно обратиться к краулерам всех поисковиков. Тег meta «googlebot», «yandex» или «любой другой бот» говорит о том, что инструкции адресованы соответствующему поисковому роботу. Если краулеров несколько, для каждого создают отдельный тег.

Атрибут content

Этот атрибут содержит команды, с помощью которых управляют индексированием контента на странице и отображением его элементов в результатах поиска. В него добавляют директивы из приведенных выше таблиц.

Примечания:

Файл robots.txt и метатег robots meta

При обходе сайта поисковые боты в первую очередь обращаются к файлу robots.txt. В нем они получают рекомендации по сканированию страниц и затем переходят к их обработке. Поэтому если доступ к странице закрыт в файле robots.txt, робот не сможет просканировать страницу и обнаружить в коде запрет индексации.

Если страница содержит атрибут noindex, но при этом закрыта от сканирования в robots.txt, она может отобразиться в результатах поиска — например, если робот найдет страницу, перейдя по обратной ссылке из другого источника. Содержимое файла robots.txt является общедоступным, поэтому нельзя быть уверенными, что на «закрытые» страницы не будет переходов.

Следовательно, закрывая страницу от индексации метатегом robots, стоит убедиться в отсутствии препятствий для ее сканирования в файле robots.txt. К исключениям, когда robots.txt имеет смысл использовать для скрытия из индекса, относятся изображения.

Как внедрять метатег robots

Редактирование страниц аналогично работе с текстовым файлом. Нужно найти документ, открыть его в текстовом редакторе, добавить метатеги robots в раздел и сохранить.

Страницы находятся в корневом каталоге сайта, куда можно перейти из персонального аккаунта хостинг-провайдера или по FTP. Перед внесением правок стоит сохранить исходный вариант документа.

Более простой способ закрыть страницу от индексации — через админпанель CMS. Например, SEO-плагины «All in one SEO» и «Yoast SEO» для WordPress дают возможность запретить индексацию или переходы по ссылкам в режиме редактирования страницы.

Как проверить метатег robots

Поисковой машине нужно время, чтобы проиндексировать/деиндексировать страницу. Чтобы убедиться в отсутствии страницы в поиске, нужно воспользоваться сервисом для вебмастеров или плагином для браузера, проверяющим метатеги, например, SEO META in 1 CLICK для Chrome.

Google и Яндекс дают возможность проверить наличие страницы в индексе — для этого есть инструмент «Проверка URL» Google Search Console и аналогичная опция «Проверить статус URL» в Яндекс.Вебмастере.

Если анализ страницы показал, что метатег robots не сработал, нужно проверить, не заблокирован ли этот URL в файле robots.txt, обратившись к этому файлу через строку браузера или используя инструмент для проверки от Google или Яндекса.

Также проверить наличие страниц в индексе для разных поисковых систем можно с помощью инструмента «Проверка индексации» в SE Ranking.

Что такое X-Robots-Tag?

X-Robots-Tag является частью HTTP-ответа для того или иного URL. Его добавляют в файл конфигурации. Он выполняет схожие функции с метатегом robots, влияя на индексацию страниц, но бывают ситуации, когда стоит применять именно заголовок X-Robots-Tag.

Пример тега X-Robots-Tag

Когда нужно задать правила для определенной страницы или типа файлов, X-Robots-Tag в файле конфигурации выглядит так:

Директива ищет на сайте указанные файлы, используя регулярные выражения. При использовании Nginx вместо Apache ее заменяет location.

Если имя робота не указано, директивы по умолчанию действуют для всех краулеров. При формировании ответа определенному роботу тег выглядит так:

Когда используют X-Robots-Tag

Пример — скрытие PDF-документов сайта из индекса:

При использовании метатега robots бот сначала загружает страницу, а потом считывает информацию из директив относительно индексации. В то время как тег x-robots информирует робота до обхода. Таким образом поисковик не тратит время на сканирование страниц и сохраняет краулинговый бюджет на более полезный контент. Это особенно актуально для крупных ресурсов.

Использование X-Robots-Tag в HTTP-ответах дает возможность указывать директивы и управлять индексацией контента в масштабе не отдельных страниц, а всего ресурса.

Самые известные и широко используемые поисковики понимают большинство запрещающих директив. Но в разных странах иногда используют локальные поисковые системы, которые могут не воспринимать, например, информацию об индексировании через HTTP-заголовки.

Перед тем как оптимизировать сайт под тот или иной регион, стоит узнать, какие системы используют местные жители, и изучить особенности работы с ними.

Основная функция метатега robots — скрытие определенных страниц или элементов контента из результатов органической выдачи. X-Robots-Tag дает возможность задавать условия масштабно — на уровне всего сайта, а также информировать робота без необходимости обхода страницы, что экономит краулинговый бюджет.

Как внедрять X-Robots-Tag

Для добавления заголовка X-Robots-Tag используют файлы конфигурации в корневом каталоге ресурса. Настройки могут отличаться в зависимости от используемого веб-сервера.

Apache

Пример: запрет индексации всех png и gif-файлов сайта в Apache.

NGINX

Необходимо внести правки в файл конфигурации conf.

Пример: запрет индексации всех png и gif-файлов сайта в NGINX.

Важно: перед редактированием файла конфигурации необходимо сохранить исходный вариант, чтобы избежать проблем в работе сайта в случае ошибок. Лучше всего доверить это вебмастеру / админу.

Как проверить HTTP-заголовок X-Robots-Tag

Есть несколько способов узнать, какой ответ отдает HTTP-заголовок страницы и содержит ли он X-Robots-Tag: онлайн-сервисы для проверки URL, расширения для браузеров, инструменты для вебмастеров от Google и Яндекса.

Пример заголовка, который запрещает индексацию

Проверка HTTP-заголовка тега x-robots в Google

В Google Search Console нужно перейти в раздел «Проверка URL», затем ввести адрес страницы, выбрать «Проверить страницу на сайте» и «Изучить отсканированную страницу». Во вкладках будет доступна информация об ответе HTTP.

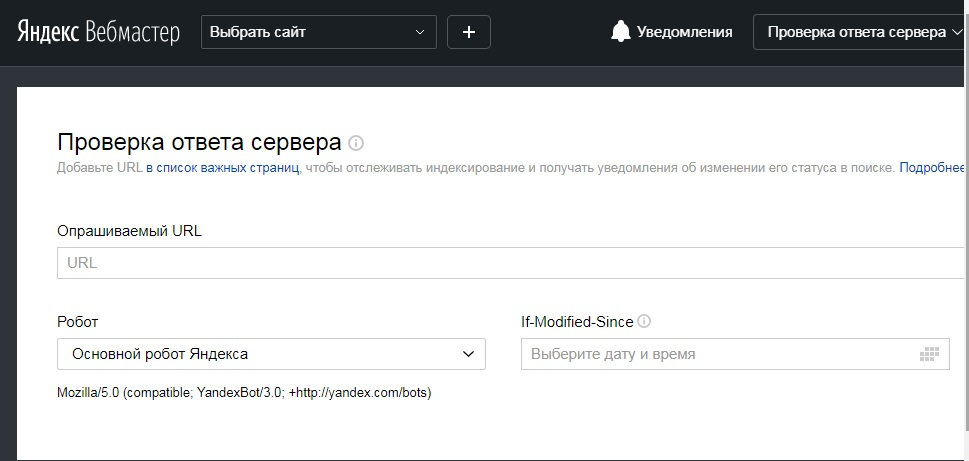

Проверка HTTP-заголовок тега x-robots в Яндекс

В Яндекс.Вебмастере нужно выбрать в выпадающем списке «Проверка ответа сервера» и ввести адрес страницы.

Примеры метатега robots и X-Robots-Tag

noindex

Запрет индексации текста страницы и перехода по ссылкам для всех роботов:

nofollow

Запрет перехода по ссылкам на странице роботу Яндекса:

noarchive

Запрет показа в поиске кэшированной версии страницы в разделе Яндекс.Новости:

none

Запрет индексации и перехода по ссылкам для googlebot в html-документе:

nosnippet

Запрет отображение фрагментов страницы в результатах поиска Google:

max-snippet

Ограничение длины сниппета до 35 символов:

max-image-preview

Показ крупных изображений страницы в результатах поиска:

max-video-preview

Отображение видео в поиске без ограничений по длительности:

notranslate

Запрет перевода страницы на другие языки:

noimageindex

Запрет индексации картинок страницы:

unavailable_after

Отсроченный запрет индексации (после 1 января 2021 года):

noyaca

Запрет использования автоматически сгенерированного описания:

Ошибки использования robots и X-Robots-Tag

Несогласованность с файлом robots.txt

В официальных справках по X-Robots-Tag и метатегу robots в Google и Яндексе сказано, что у поискового робота должен быть доступ к сканированию контента, который нужно скрыть из индекса. В этом случае указание директивы disallow для определенной страницы в файле robots.txt делает невидимыми директивы страницы, в том числе запрещающие индексацию.

Еще одной ошибкой является попытка запретить индексацию страниц с помощью robots.txt. Основная функция robots.txt — в ограничении сканирования, а не запрете индексации. Следовательно, для управления отображением страниц в поиске нужно использовать метатег robots и тег x-robots.

Несвоевременное удаление атрибута noindex с актуальной страницы

Если вы используете директиву noindex, чтобы временно скрыть контент из индекса, важно вовремя удалить ее со страницы и открыть роботу доступ. Например, это может быть страница с запланированным акционным предложением, которое уже вступило в силу. Или же станица, которая была в процессе разработки и теперь полностью готова. Если директиву не убрать, страница не появится в выдаче, а значит не будет генерировать трафик.

Наличие обратных ссылок на страницу с атрибутом nofollow

Команда nofollow может не сработать, если сама страница — не единственный способ для поисковика узнать об URL-адресах, и на них ведут внешние ссылки с «открытых» источников.

Удаление URL-адреса из карты сайта до его деиндексации

Если страница содержит директиву noindex или отдает запрет индексации URL, стоит ли ее удалить из файла sitemap.xml? Такое решение будет неверным, поскольку карта сайта дает роботу возможность быстрее находить все страницы, в том числе те, которые нужно убрать из индекса.

Правильным решением будет создать отдельный файл sitemap.xml со списком страниц, содержащих директивы noindex, и удалять URL оттуда по мере их деиндексации. Чтобы ускорить процесс обхода дополнительной карты сайта роботом, можно загрузить ее в Google Search Console или Яндекс.Вебмастер.

Отсутствие проверки индексации после внесения изменений

При самостоятельной настройке индексации или в ходе работы программиста бывают ситуации, когда важный контент ошибочно оказался под запретом индексации. После внесения изменений страницы сайта нужно проверять.

Как избежать ошибочной деиндексации важных страниц?

Кроме проверки индексации URL указанными выше способами, можно отследить изменения кода на сайте с помощью инструмента «Отслеживание изменений» в SE Ranking.

Как быть, если актуальная страница перестала отображаться в поиске?

Необходимо удалить директивы, запрещающие индексацию страницы, а также проверить, нет ли запрета ее сканирования командой disallow в robots.txt и указан ли ее адрес в файле sitemap. Запросить индексацию URL, а также уведомить поисковики об обновленной карте сайта можно через Яндекс.Вебмастер и Google Search Console.

Больше информации можно найти в статье о принципах индексации сайта в поисковиках.

Заключение

Метатег robots и тег x-robots — это инструменты для управления индексацией и отображением страниц сайта в результатах поиска. Отличаются они способом реализации: метатег robots указывают в коде страницы, а X-Robots-Tag — в файле конфигурации на сервере. У них есть и другие особенности: